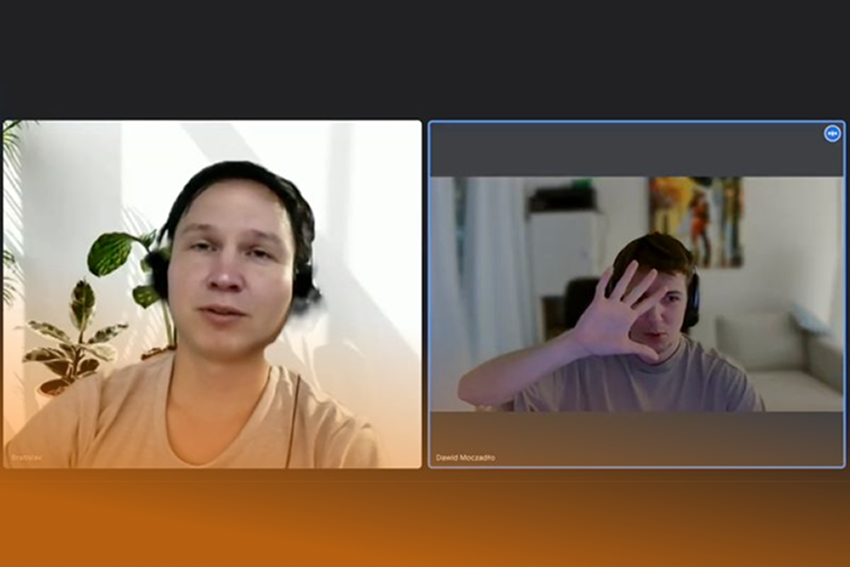

To nie kandydat. To deepfake. Dezinformacja, odporność cyfrowa i nowe zasady pracy w erze AI

Wyobraź sobie, że prowadzisz rozmowę rekrutacyjną. Kandydat wygląda profesjonalnie, mówi przekonująco, zna techniczne szczegóły stanowiska. Tyle że… nie istnieje. Dlaczego to ważne w pracy?

To nie science-fiction. W 2024 roku firma z branży technologicznej została oszukana przez kandydata, który brał udział w rozmowie zdalnej jako… deepfake – syntetyczny awatar stworzony z pomocą sztucznej inteligencji. Cały proces rekrutacji odbył się z fałszywą osobą. Sprawę opisał The Pragmatic Engineer w artykule AI Fakers.

W dobie pracy zdalnej i globalnych procesów zatrudniania, deepfake w rekrutacji nie jest już wyjątkiem – to rosnące zagrożenie.

W środowisku pracy:

- Deepfake’i mogą prowadzić do sabotażu reputacji, oszustw finansowych i manipulacji decyzyjnej;

- Lęk przed manipulacją cyfrową wpływa na obniżenie zaufania do systemów komunikacyjnych;

- Zmniejsza się zdolność zespołu do działania w sytuacjach kryzysowych bez dezinformacji.

📊 Dlaczego menedżerowie i HR powinni być czujni?

- Według Du et al., 2025, 62% pracowników nie potrafi jednoznacznie odróżnić deepfake’a od prawdziwej osoby w warunkach zdalnego kontaktu.

- Aż 1 na 4 amerykańskie firmy w 2023 roku zgłosiły przypadki rekrutacyjnych oszustw związanych z AI – głównie w sektorze IT (Williamson & Prybutok, 2024).

- Według badań Gupta et al., 2025, rosnący lęk przed manipulacją AI wpływa na jakość decyzji kadrowych i wzmacnia „technostres” zespołów HR.

🔐 Jak chronić się przed rekrutacyjnymi deepfake’ami?

1. Zmieniaj kanały kontaktu

Nie ograniczaj się do jednej wideorozmowy. Wprowadź testy techniczne w czasie rzeczywistym, krótką rozmowę telefoniczną lub nagranie głosowe z prośbą o opisanie projektu.

2. Obserwuj mikroekspresje

Deepfake często „nie mruga”, nie zmienia mimiki w sposób naturalny. Uważaj na sztuczne uśmiechy, nieruchome tło, idealne oświetlenie. Jeśli coś wygląda „zbyt dobrze” – warto sprawdzić dokładniej.

3. Analizuj metadane i dokumentację

Sprawdź, czy CV jest spójne z danymi z LinkedIna, GitHuba czy rejestrów branżowych. Porównuj czas publikacji profili, aktywność, spójność dat.

4. Ustal standardy bezpieczeństwa w HR

Wprowadź wewnętrzną checklistę dla menedżerów i rekruterów z sygnałami ostrzegawczymi. Uwzględnij:

- brak historii w social media,

- reakcje nieadekwatne do pytań sytuacyjnych,

- opóźnienia głosu względem obrazu.

🧭 To nie tylko technologia – to zaufanie, które może zostać złamane

Deepfake uderza w rdzeń procesu zatrudnienia – zaufanie do ludzi i danych. W czasach, gdy pierwszym kontaktem z kandydatem jest ekran, menedżerowie i zespoły HR muszą działać z większą uważnością poznawczą niż kiedykolwiek.

🎓 Chcesz nauczyć się więcej o odporności cyfrowej? Zapraszamy na moduł „Cyfrowa odporność i krytyczne myślenie w erze AI”

Nauczysz się:

- jak rozpoznawać fałsz w komunikacji cyfrowej,

- jak nie ulegać błędom poznawczym,

- jak zbudować odporność poznawczą i emocjonalną w pracy pełnej informacji, bodźców i niepewności,

- jak świadomie współpracować z AI, zamiast się jej bać.

👉 Jeśli rekrutujesz, zarządzasz lub podejmujesz decyzje – zapisz się.

Zaufanie nie jest naiwnością. Ale musi być świadome.

📚 Źródła i badania:

- Du, J. et al. (2025). The issues caused by misinformation—How workers and organizations deal with it. JASIST. PDF

- Williamson, S.M., & Prybutok, V. (2024). The era of artificial intelligence deception. MDPI Information. PDF

- Gupta, N. et al. (2025). Teaching Students Essential Survival Skills in the Age of Generative AI. ASEE Conference. PDF

- Shalaby, A. (2024). Cognitive AI hazards. Springer. PDF

- Hameed, R.M. et al. (2024). Deepfake advertising disclosure and trust. ResearchGate. PDF

- Shin, D. (2024). Artificial misinformation: Trust in the AI era. Springer. PDF

🔔 Zapisz się zanim kolejny deepfake zrujnuje Twój dzień pracy

Ten moduł poprowadzą: dr Barbara Zych oraz Gość specjalny!